L'évolution rapide de la technologie a donné naissance à une ère où l'intelligence artificielle (IA) joue un rôle croissant dans divers aspects de nos vies. Autrefois réservée aux entreprises, elle a fait son entrée parmi le grand public avec ChatGPT et Dall-E par exemple. Mais qu'est-ce que l'intelligence artificielle et pourquoi ce terme est-il utilisé pour décrire ces technologies ?

L'intelligence artificielle se réfère à la capacité des machines à imiter certaines fonctions cognitives humaines, telles que l'apprentissage, la résolution de problèmes et la prise de décision. Ce concept englobe un large éventail de technologies, allant des algorithmes de traitement de données aux systèmes complexes d'apprentissage automatique. L'utilisation du terme "artificielle" souligne que ces capacités ne sont pas intrinsèques à une intelligence biologique, mais plutôt créées de manière intentionnelle par l'homme. Néanmoins, l'utilisation de ce terme prête à confusion et soulève des débats éthiques profonds. Qu'est-ce que l'intelligence ? Une machine peut-elle être intelligente, et même peut-elle avoir une conscience ou un libre-arbitre ? Quel avenir pour l'homme s'il est en concurrence avec les IA ?

Cette intelligence artificielle trouve désormais sa place dans le monde de la thérapie, offrant de nouvelles perspectives sur la manière d'aborder la santé mentale et le développement personnel.

La mystérieuse IA

Comment fonctionne Chat-GPT

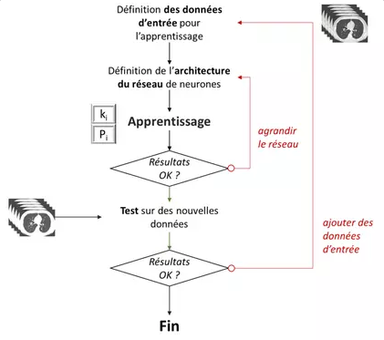

Pour comprendre comment tout cela est possible, il faut d'abord comprendre comment fonctionne une IA. L'IA étant un ensemble de thématiques de recherche scientifique (pour ma part, j'avais fait un peu de Machine Learning pendant ma thèse), je ne vais bien sûr pas tout aborder, mais je vais simplement étudier le cas de ChatGPT.

ChatGPT est le produit commercial d'OpenAI qui repose sur un modèle d'IA appelé GPT (Generative Pre-trained Transformer). Les Transformers ont été développés initialement pour le traitement automatique du langage naturel (NLP), pour faire de la traduction, de la classification ou de la génération de textes.

ChatGPT est ce que l'on appelle un chatbot, ou agent conversationnel, et contrairement aux anciens chatbots qui fonctionnaient à partir de mots-clefs pour vous répondre... un peu n'importe quoi en fait, ChatGPT repose sur un algorithme d'IA de NLP dont le seul but est de compléter une phrase par le mot le plus logique (en réalité des morceaux de mots, appelés tokens). Si on demande au modèle de continuer à ajouter des mots, on obtient des phrases entières, puis des paragraphes. Il s'agit donc d'un modèle qui fonctionne uniquement sur de la probabilité, basée sur le vaste ensemble de données fournies au moment de la phase dite d'apprentissage du modèle. Il n'y a aucune notion de vérité ou de compréhension, c'est d'ailleurs pourquoi ChatGPT invente, par exemple, des citations que des gens célèbrent auraient pu dire. Faites l'essai et vérifiez si vous retrouvez ces citations. Pour la plupart, elles n'existent pas, elles sont juste plausibles, par rapport aux textes qu'il a reçus pour s’entraîner au départ.

La phase d'apprentissage de GPT a lieu une seule fois puis est figée, c'est la raison pour laquelle vous avez plusieurs versions de GPT, actuellement la 3.5 en version gratuite et la 4.0 en accès payant. Cela signifie aussi que les conversations que vous pouvez avoir avec lui ne sont pas intégrées dans la version que vous utilisez. En revanche, ChatGPT peut se souvenir d'un contexte, ce que vous lui indiquez dans vos fenêtres de conversation, qui peut aller jusqu'à une centaine de pages pour la dernière version (4.0).

Comme les mots sont choisis avec des probabilités, cela veut dire que, grossièrement, on peut modéliser ses réponses sous forme de gaussienne.

Une gaussienne, c'est une courbe en forme de cloche, comme les figures ci-dessous, souvent utilisée avec les probabilités et correspondant à ce qu'on appelle une loi normale. Pour faire simple, on peut considérer que les comportements humains, les mots, les façons de penser... peuvent être modélisés par des gaussiennes. Dit autrement, on considère que 80% de la population se trouve dans la gaussienne (la cloche), 10% se trouve en queue et 10% en tête, quel que soit le paramètre qu'on étudie. Ci-dessous, vous avez deux exemples de gaussienne, celle de répartition des revenus des ménages de 2014 en France et celle du QI.

Ce sera exactement la même chose pour les textes et les mots utilisés. Il y a donc de grande chance que ChatGPT vous propose des réponses assez standard mais pas dénuées d'intérêt, c'est-à-dire juste dans la gaussienne. Il ne vous répondra rien de complètement idiot ni rien qui sorte complètement de l'ordinaire.

IA et Langage

Etienne Klein a reçu Alexei Grinbaum, spécialiste des intelligences artificielles au CEA, dans son podcast la Conversation scientifique sur France Culture. Parmi les sujets abordés, j'ai trouvé particulièrement intéressant celui autour de la parole.

Il y est évoqué l'effet Eliza qui désigne la tendance à assimiler de manière inconsciente le comportement d'un ordinateur à celui d'un être humain. Celui-ci tire son nom du chatbot ELIZA, élaboré en 1966 par Joseph Weizenbaum, informaticien au MIT. Bien qu'il soit conçu uniquement pour soutenir une conversation en langage naturel, le script DOCTOR du programme ELIZA serait parvenu à déclencher une réponse émotionnelle de la part des utilisateurs. D'un point de vue psychologique, l'effet ELIZA résulterait d'une dissonance cognitive subtile entre la conscience de l'utilisateur vis-à-vis des limites du programme et son comportement à l'égard des informations générées par celui-ci.

"Même si vous savez que c'est une machine qui est derrière un texte ou une voix, cette machine produit sur vous, à travers le langage, un vrai impact, un véritable effet émotionnel, psychologique. Du moment où la machine vous parle en langue naturelle, même si vous savez que c'est une machine, peu importe, vous pouvez le savoir et pourtant vous allez vivre une transformation émotionnelle, psychologique majeure tout en sachant que c'est une machine qui parle. Ce rôle de miroir qui, à nous les êtres humains nous permet de nous comprendre mieux, de nous connaître un peu mieux, ce rôle de miroir appartient aujourd'hui aux systèmes techniques." A. Grinbaum

A. Grinbaum fait également un rapprochement entre l'impact du langage naturel non-humain et les interactions avec les "divinités", anges, guides... Même s'il évoque une époque révolue pour lui, la comparaison reste pertinente.

"Autrefois, il [le rôle de miroir] appartenait aux oracles par exemple, aux anges et démons qui nous parlaient en notre langue sans être humains, bien sûr. Ceux qui posaient des questions, ceux dont les vies étaient transformées par les réponses de l'oracle, savaient bel et bien que ce n'était pas un être humain qui leur parlait, et pourtant, ils découvraient à chaque fois quelque chose à propos d'eux même, de leur vie, de leur monde. Aujourd'hui, les IA nous amènent dans un monde où, au quotidien, nous côtoyons des agents non-humains, qui nous parlent en notre langue, comme autrefois nos ancêtres vivaient dans un monde où des anges, des démons et des oracles, qui pour eux étaient tout à fait réels, leur parlaient en leur langue sans être humains."

C'est donc l'effet que la parole va avoir sur nous, la réaction émotionnelle et psychologique, qui compte et qui permet d'envisager un usage thérapeutique des IA.

A. Grinbaun et E. Klein ouvrent également la porte vers un mystère :

A.G. : - "Comment est-ce possible qu'une machine imite si bien notre hasard naturel, notre libre-arbitre naturel ? Ça, on n'a toujours pas de réponse scientifique, on est tombé sur cette capacité des machines, mais on ne sait pas pourquoi.

E.K. : - Peut-être notre libre-arbitre est-il déterminé par des processus analogues ?"

(cf. le billet de blog L'univers est chaotique pour poursuivre cette réflexion.)

L'IA au service du développement personnel

IA et santé mentale

L'intelligence artificielle (IA) se positionne désormais comme une alliée prometteuse dans le domaine de la santé mentale, venant enrichir et améliorer les approches thérapeutiques traditionnelles. Toutefois, les professionnels de la santé restent prudents, préférant des approches combinées impliquant à la fois l'IA et le thérapeute. Plutôt que de remplacer l'interaction humaine, l'IA est conçue pour compléter et optimiser les pratiques existantes, offrant ainsi de nouvelles propositions pour le bien-être mental. La crainte sous-jacente est bien sûr la potentielle disparition progressive de ces professions, remplacées par des systèmes d'intelligence artificielle. Car face à la compétition directe entre l'humain et les machines, la pertinence et le rôle du thérapeute dans les domaines de la santé mentale, de la psychologie et du développement personnel sont remis en question.

L'IA peut jouer un rôle crucial en fournissant un soutien continu entre les sessions thérapeutiques. Par exemple, des applications utilisant des algorithmes sophistiqués peuvent suivre les habitudes émotionnelles des utilisateurs au fil du temps. Ceci permet aux thérapeutes d'avoir un aperçu plus approfondi du quotidien émotionnel de leurs patients, facilitant ainsi des discussions plus ciblées et personnalisées lors des séances. Les chatbots thérapeutiques représentent une application concrète et accessible de l'IA en santé mentale. Ces programmes interactifs offrent un espace sécurisé pour l'expression émotionnelle, fournissant des conseils et des encouragements plus ou moins adaptés. Des applications de suivi émotionnel utilisant des techniques d'analyse du langage naturel peuvent détecter des tendances émotionnelles, aidant ainsi les utilisateurs à mieux comprendre et à mieux gérer leurs états mentaux. Les professionnels de la santé peuvent également bénéficier d'outils d'analyse de données alimentés par l'IA. Ces outils peuvent traiter de vastes ensembles de données pour identifier des schémas et des tendances qui échapperaient peut-être à l'œil humain. Cela permet aux thérapeutes d'ajuster leurs approches en fonction des besoins spécifiques de chaque individu, améliorant ainsi l'efficacité globale des interventions thérapeutiques.

Actuellement, plusieurs applications et chatbots, principalement en anglais, sont en phase de test, présentant des résultats plus ou moins encourageants. Ces chatbots reposent sur une démarche médicale conventionnelle qui tend à contrôler le processus de diagnostique en fonction des symptômes pour fournir des réponses appropriées. Néanmoins, cette tâche est actuellement irréalisable pour l'IA. Pour ma part, j'ai testé SommerAI qui ne fonctionne pas en français. Mindsum et Pi sont cohérents pour la langue, mais en quatre échanges, on aboutie déjà à des conseils, qu'ils soient pertinents ou non, et la discussion se termine. Il me reste à tester Lotus, saturé en version gratuite et JungGPT qui n'existe qu'en version payante.

clairebot, une ia pour les schémas de comportement

En envisageant le thérapeute, le praticien ou le facilitateur non plus en position haute, dans le rôle de sachant, mais simplement comme un miroir guidant le processus d'auto-guérison, on explore une approche totalement différente que l'IA peut tout à fait jouer en posant correctement des questions. Cette perspective met l'accent sur la facilitation de l'auto-exploration plutôt que sur la fourniture de réponses directes. C'est la stratégie que j'utilise en séance et que j'ai choisie dans le développement de ClaireBot.

ClaireBot, ce n'est pas seulement une IA, c'est un guide à travers les étapes d'éveil de soi et de libération des chaînes. Là où d'autres robots pourraient donner des conseils trop hâtifs, le ClaireBot vous aide à analyser, à comprendre, à débloquer, tout en respectant votre rythme. Il est spécialisé dans le questionnement de l'émotionnel et des schémas de comportement limitants.

L'aventure extraordinaire du ClaireBot a commencé au cours d'une conversation avec une amie passionnée des technologies au Canada. Insatisfaite de sa thérapeute traditionnelle qui ne comblait pas ses besoins d'exploration profonde, elle aurait voulu que je puisse l'accompagner, mais avec le décalage horaire, ce n'était pas si simple. C'est alors qu'elle me dit "Si une IA pouvait me guider comme toi, à n'importe quelle heure du jour ou de la nuit, ce serait génial !"

Cette simple phrase a été le point de départ d'une aventure qui allait transformer cette idée en réalité. Inspirée par cette vision, j'ai travaillé en remettant ma casquette d'ingénieur pour donner naissance au ClaireBot. Il ne fait aucune suggestion, il pose simplement des questions qui résonnent profondément avec vos schémas inconscients, ouvrant la voie à une exploration introspective en ligne sans précédent. En creusant dans votre enfance, il vous invite à décrire vos émotions, à explorer les tréfonds de votre être pour dénicher des nœuds cachés.

Voici quelques témoignages à son sujet.

"J’ai trouvé une densité, dans la libération, pour dire au revoir au schéma. ClaireBot est super, vraiment à ton image, comme en séance individuelle avec toi, dans les questions qu’il peut poser ou les phrases proposées. Je réutiliserai cet Atelier Libération. Un grand merci. ” Sandrine

“J’avais jamais utilisé l’intelligence artificielle et franchement ClaireBot est assez bluffant. C’est hyper pertinent. Et tous les supports que tu as proposé nous guidaient vraiment bien dans ce qu’on devait faire. J’avais jamais fait d’exercices et avec les retours individuels aussi, ça m’a bien aidé. Je suis prête à continuer avec toi.” Laetitia

"Il faut vraiment être au calme pour faire ça, pour pouvoir se libérer, c’est tellement bouleversant par moments. J’ai jamais fait un truc pareil, comme ça, par ordinateur. C’est super intéressant et peu courant. ClaireBot, franchement, je me suis un petit peu amusée. C’est comme si je le titillais, mais comme si je me titillais moi, en passant par lui, c’était drôle ! J’ai trouvé ça génial." Valérie

"Le ClaireBot est bluffant ! J'aime la manière de dérouler le fil, j'ai l'impression d'un chouette mouvement entre comment je me sens / comment ça résonne avec mon enfance / le rapport avec ce qui se passe au présent / ce que ça me donne envie de faire / comment je me sens avec ces actions etc. Très chouette cet art de la reformulation et du questionnement. J'ai pu m'abandonner et me laisser guider et ça m'a amené à un certain niveau de profondeur. J'ai l'impression que c'est globalement auto-porteur. Je me suis laissé prendre au jeu et j'ai oublié la consigne de gérer l'arrêt. J'ai été interrompu par le début du repas en famille..." Serge

Futur et éthique

Bien sûr l'IA, peut faire peur. Lorsqu'elle est utilisée sans consentement, on arrive vite à des scénarii invasifs où l'IA pourrait servir à interagir avec la personne pour enregistrer ses émotions, ses pensées, ses modes de vie ; surveiller son humeur sur les téléphones portables ou faire des diagnostics non demandés. Les questions de la confidentialité des données et de la consommation d'énergie se posent également. Dans sa phase d'apprentissage, une IA consomme l'équivalent de l'énergie d'une petite ville pendant quelques mois et représente un immeuble rempli de serveurs informatiques. Aussi, lors de cette phase d'apprentissage, qui décidera du comportement politiquement acceptable de celle-ci ? Qui décidera que telle pensée est un biais ou telle réaction inacceptable. La question s'est déjà posée pour l'utilisation des insultes, et là où cela posait question dans les années 70, il y a consensus aujourd'hui pour acter que les insultes doivent être éliminées du langage des IA. Cela peut vous paraître une évidence pour cet exemple, et pourtant, ça ne l'est pas. Car à plus grande échelle, que deviendra notre langage ? La parole humaine va-t-elle être encore un peu plus aseptique, est-ce que nous allons parler dans la moyenne statistique avec des mots triviaux. Comment va-t-on entraîner des cerveaux humains à l'ère des IA, que vont-ils apprendre ?

Pour A. Ginbaum, "dans les décennies à venir, nous allons nous spécialiser sur ce qui sort de la moyenne, sur le beau et le vrai, parce que la moyenne, elle, sera assurée par les machines, sera fourni, générée, par les systèmes d'intelligence artificielle." La machine ne saura pas dire ce qui est beau ni ce qui est vrai. Et l'humain ? Le peut-il vraiment ? Qui en décidera ? "Le vrai problème est celui de la vitesse, il ne faut pas que ce changement arrive trop vite. Il arrive très rapidement technologiquement, mais le changement humain prend des générations. Il nous faudra une ou deux générations pour l'intégrer à la vie de la société."

Pour aller plus loin

La video de David Louapre, Science Étonnante, sur le modèle d'IA soujacent à ChatGPT.

La parole humaine serait-elle en train de perdre la parole ?

La conversation scientifique - Etienne Klein

VOUS AIMEREZ AUSSI

ÉCRIT PAR :

AURIGAE - Claire Le Baron

Chercheur, formatrice et consultante en énergétique multidimensionnelle et géobiologie, j'ai changé de carrière en 2015 pour devenir thérapeute énergétique à plein temps. A l'origine ingénieur de recherche spécialisée dans la modélisation des ondes et le vibratoire, je fais à présent des ponts entre les sciences et ma compréhension de l'énergétique.

Écrire commentaire